Wie hier angekündigt, nutzte ich den Beobachtungsabend vom 8. März auch für die Erstellung von Videoaufnahmen des Monds, um sie zu einem Mondmosaik zusammenzusetzen. Insgesamt sind es 56 Aufnahmen geworden. Damit die Resultate meiner Bearbeitungen einigermaßen transparent sind, zeige ich Ausgangsmaterial und die zwei wesentlichen Zwischenresultate. Videoaufnahme eines Mondbereichs:

Category: Astrofotografie

Gestern Abend war der Himmel hauptsächlich von Wolken bedeckt. Aber in kurzen Wolkenpausen war dann doch die schmale Sichel des zunehmenden Mondes zu sehen. So kramte ich Fernglas, Stativ und Smartphone-Adapter hervor und machte mich nach langer Nichtbenutzung dieser Kombination erst einmal wieder vertraut damit:

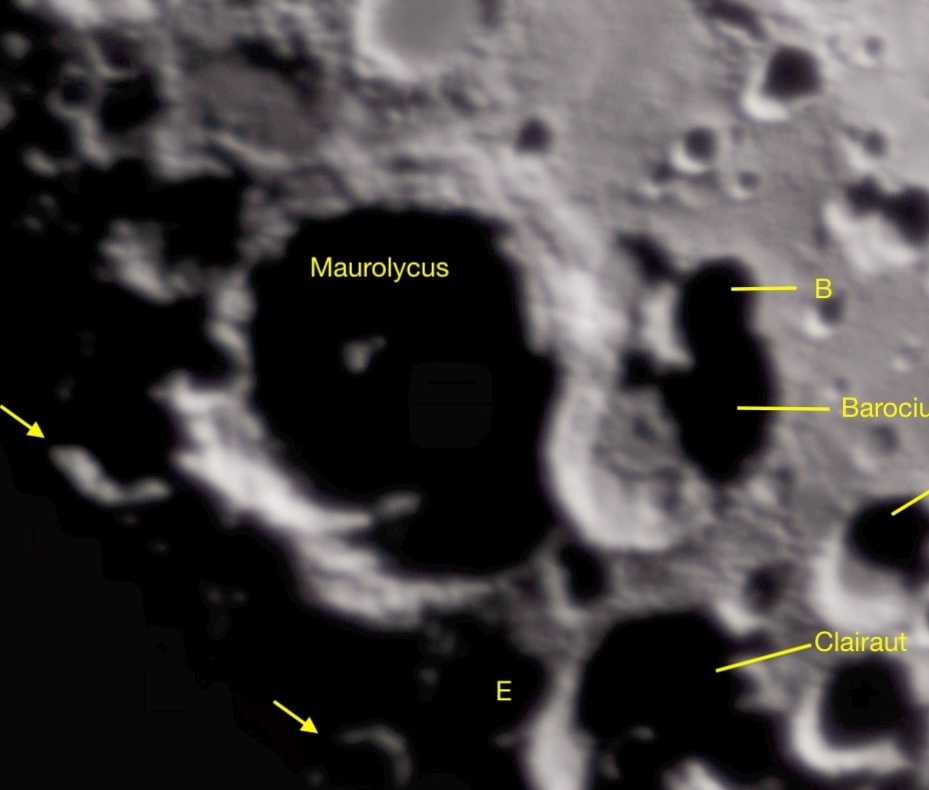

Die Tag-Nachtgrenze auf dem Mond, auch Terminator genannt, ist beliebt für die Betrachtung der kontrastreichen Strukturen von Schatten, beleuchteten Gipfeln und unterschiedlich stark schattierter Kraterebenen je nach Entfernung zum Terminator. Nehmen wir zum Beispiel die Umgebung des Krater Maurolycus.

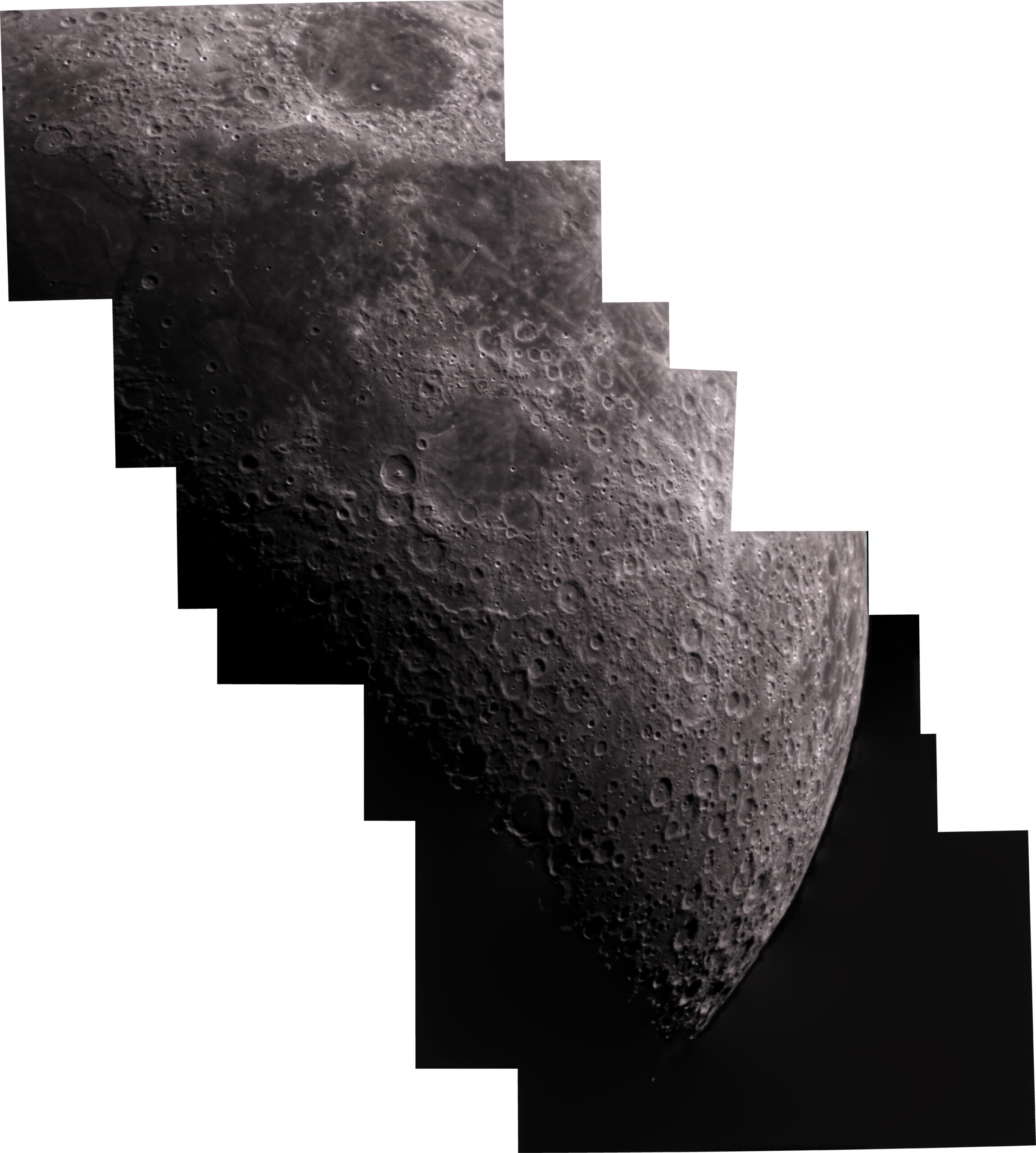

Es hat geklappt: nach dem ersten Versuch mit den schon von autostakkert umgerechneten Bildern sind nun alle 41 Bilder nahtlos zusammengefügt. Im Ergebnisbild habe ich im Nachweis die Bearbeitungsschritte und verwendete Software angegeben. Schnell die Angaben zum Mond an dem Abend: Ergebnis nach Zusammenfügen der Einzelbilder:

Gestern hatte ich den Abend genutzt, um mich mal wieder an einem Mondmosaik zu versuchen. Die Zeit war allerdings nicht unbegrenzt, weil der Mond gegen dreiviertel Elf hinter dem Dach des Nachbarhauses verschwand. Außerdem wurde ich zwischendurch noch vom Astrofuchs abgelenkt. Seit der Mittagszeit ist autostakkert beschäftigt, rund 46 Videos zu bearbeiten und entsprechend gestackte … Read More “Wochenaufgabe (für meinen Rechner und mich): Mondmosaik” »

Ergänzend zu meiner Artikelserie aus dem Beobachtungsabend vom 27. Januar kann ich noch ein Jupiterbild vom Folgetag (28.01.24) nachreichen. Dieses bringt zwar keine neue Erkenntnis zum Planeten selbst. Das “Lustige” ist allerdings, dass ich bei der Kontrastverstärkung doch tatsächlich drei der vier Galileischen Monde hervorgezaubert habe: Den vierten Mond Europa habe ich nicht mehr erfasst. … Read More “Einen Jupiter habe ich noch.” »

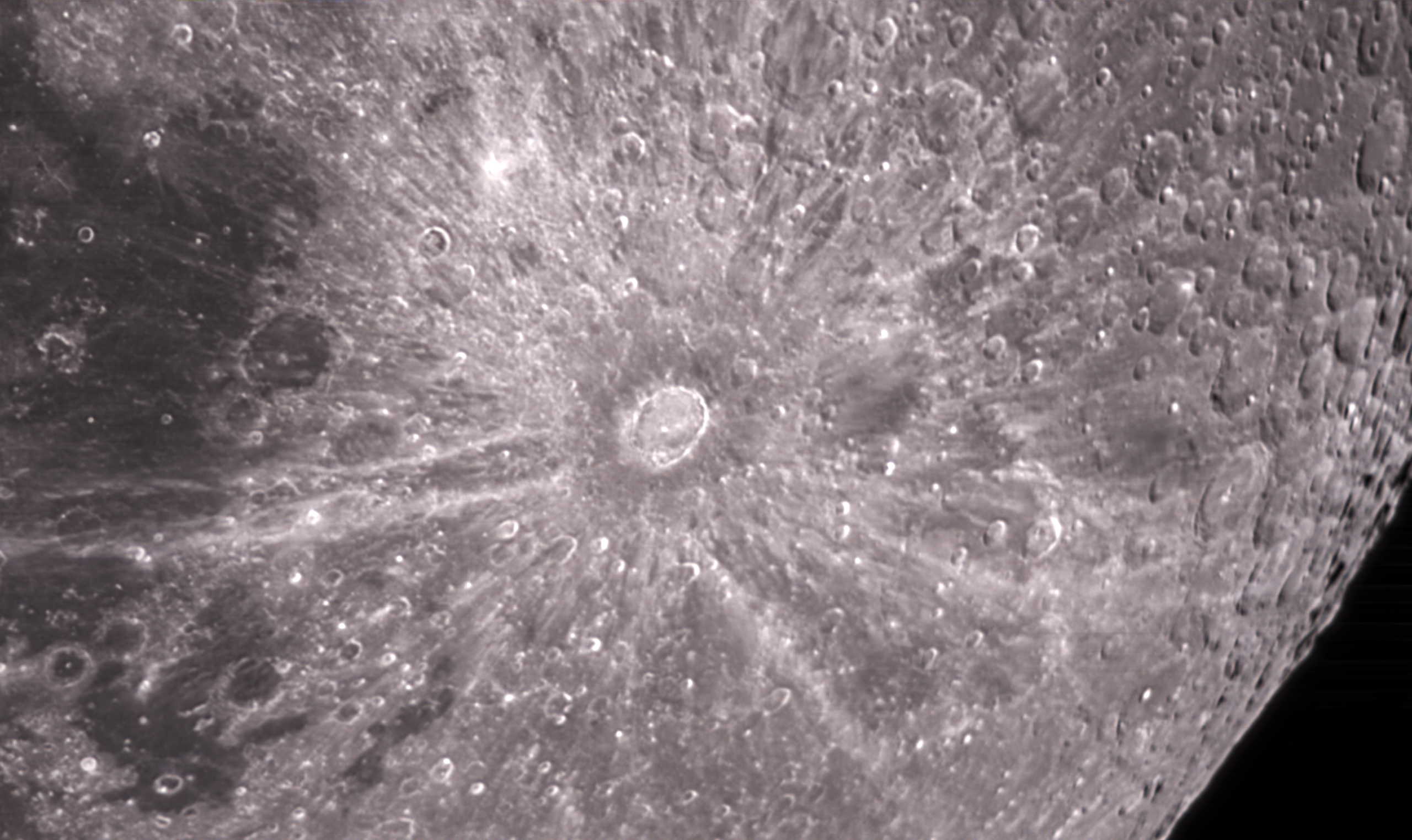

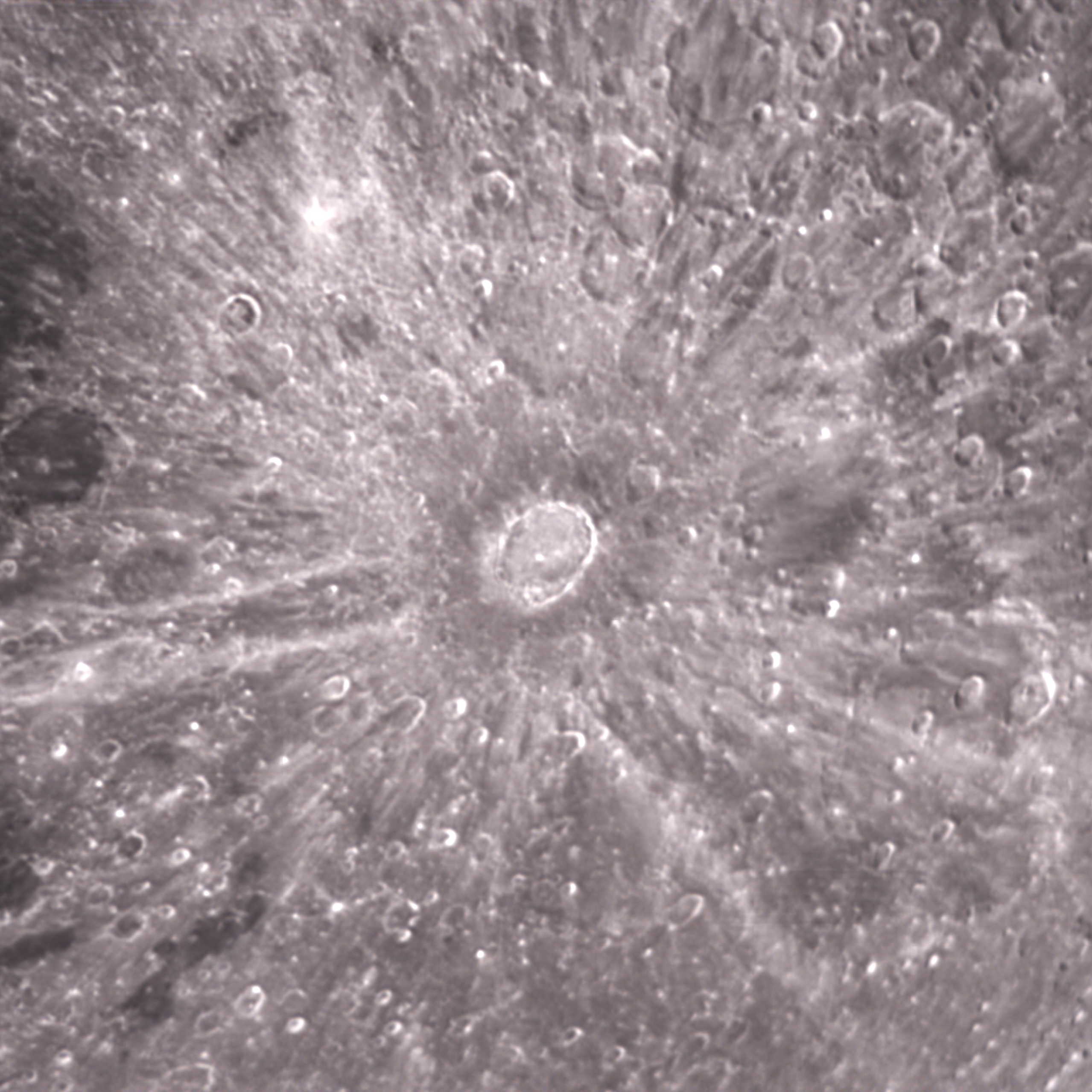

Mit einer Nachlese zum Krater Tycho schließe ich meine Teleskopeinweihung im neuen Heim ab. Der Krater Tycho samt Umgebung war eine der Mondaufnahmen an diesem Abend: Der Krater aufgrund seines hellen Strahlensystems recht bekannt. Denn die Strahlen können leicht von der Erde aus gesehen werden. Diese Oberflächenerscheinung ist das Ergebnis eines Einschlags, bei dem Material … Read More “Nachlese zum Krater Tycho vom 27. Januar” »

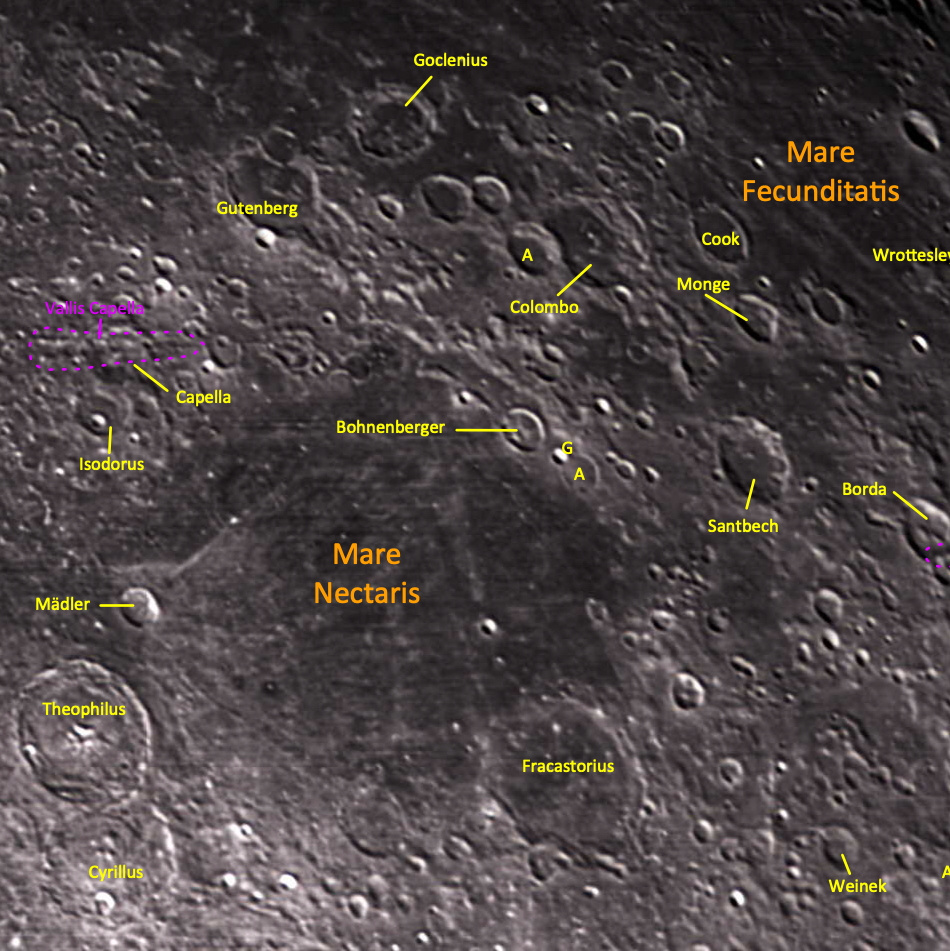

Nach dem Artikel „Das Meer der Gefahren beendet Krise bei meiner Hobbyastronomie“ kommt nun der zweite Teil meiner beschrifteten Mondaufnahmen vom 27. Januar. Wie dort erwähnt, dient die Beschriftung u.a. der Dokumentation wesentlicher Bereiche und Strukturen in der Aufnahme. Dieses Mal geht es vom Mare Nectaris bis zum Mare Fecunditatis und weiter zum Krater Petavius … Read More “Zwei Maria, vier Valles und eine Menge Krater und Strukturen unter niedrigem Sonnenstand” »

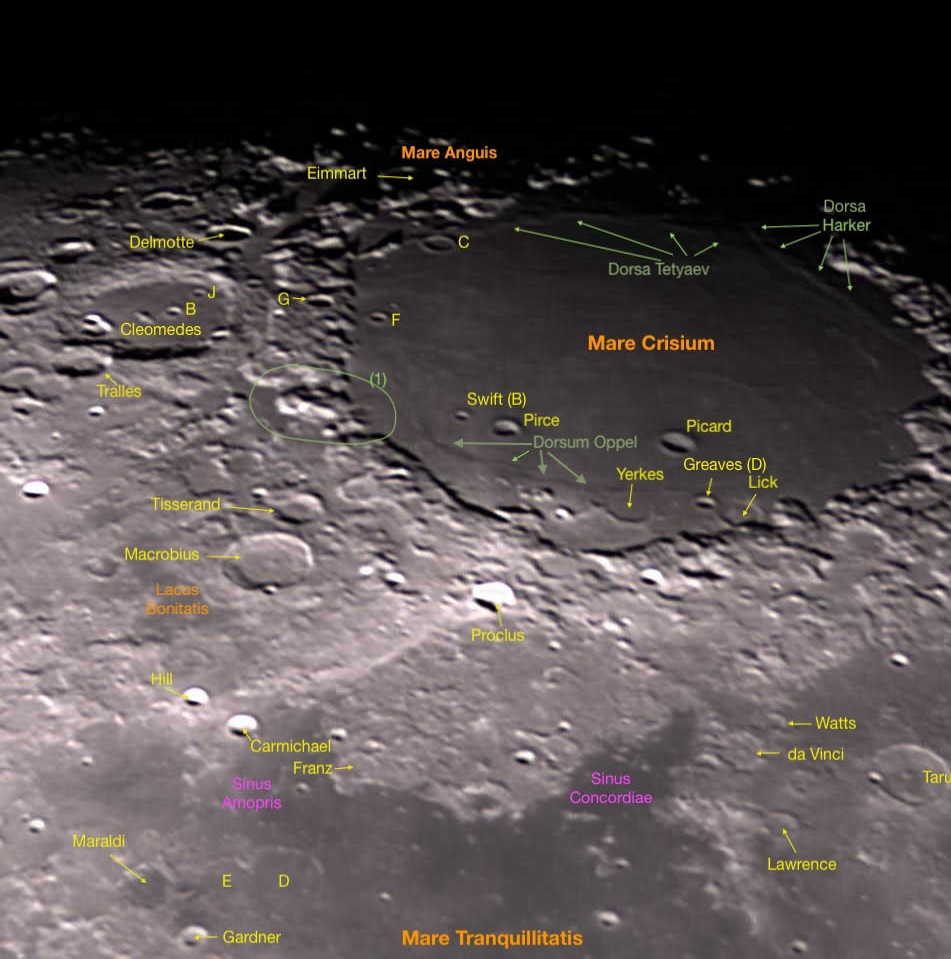

Ich schrieb schon hier, dass die lange Durststrecke beim Beobachten Ende Januar beendet wurde. Nun habe ich mir eines meiner Mondbilder etwas genauer angeschaut und anhand meiner Mondatlanten beschriftet. Die Hauptsuche findet im Mondatlas von Antonin Rükl statt. Ergänzt vom fotografischen Mondatlas des Oculum Verlags mit seinen inhaltlichen Beschreibungen.

Nach dem Umzug dauerte es noch drei Monate, ehe ich bei günstigen Himmelsbedingungen kombiniert mit ausreichender Zeit und tatsächlicher Anwesenheit zu Hause mein Teleskop einweihen konnte. Siehe dazu meinen Blogartikel hier. Eigentlich war der Abend eher der Neuausrichtung, Fokussierung und dem allgemeinen Test gewidmet, um zu klären, dass das Teleskop den Umzug gut überstanden hat. … Read More “Quick and Dirty Ergebnisse nach meiner Teleskopeinweihung im neuen Heim” »